Evolución del NLP: De IA Fragmentada a Modelos Fundamentales

Definiciones

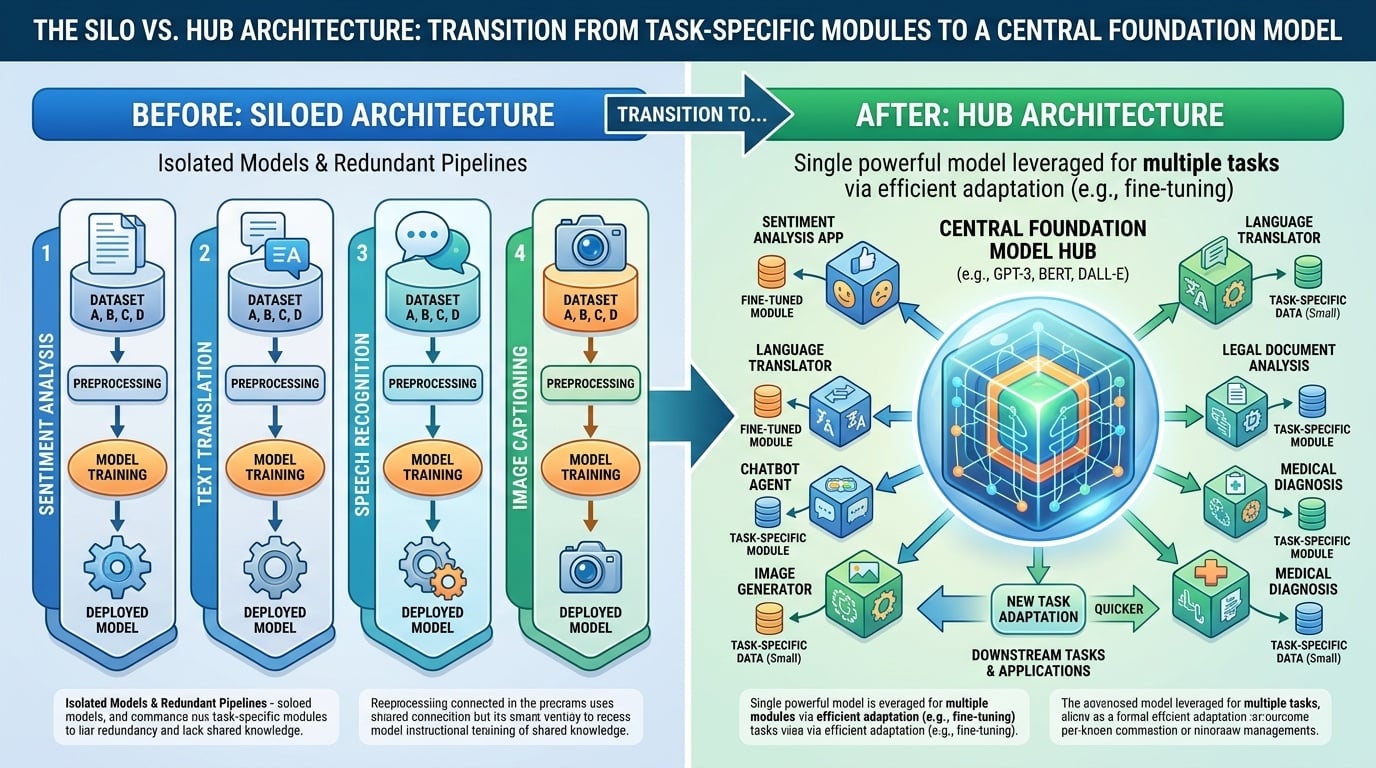

- IA Fragmentada: Una era definida por arquitecturas neuronales discretas y especializadas diseñadas para tareas individuales como etiquetado de secuencias o clasificación.

- Modelo Fundamental: Una arquitectura transformadora unificada y monolítica que trata todos los problemas lingüísticos como una secuencia generativa de texto a texto $x \rightarrow y$.

Conceptos Clave

- Consolidación Arquitectónica: Históricamente, el NLP requería pipelines personalizados (Bi-LSTM para NER, CNN para sentimientos). Los LLMs colapsan estas islas en un solo núcleo donde se utilizan los mismos pesos para todas las tareas.

- La Interfaz Unificada: Los LLMs reemplazan los "cabezales de salida" especializados (por ejemplo, Softmax de 3 clases) con una interfaz de lenguaje natural. Las entradas y salidas siempre son cadenas, permitiendo al modelo interpretar intención más que formato.

- Transferencia de Conocimiento: Los modelos tradicionales eran "tabla rasa" para cada tarea. Los LLMs priorizan Generalización Primero, donde las tareas específicas son meras aplicaciones de una representación interna preexistente y robusta del lenguaje.

Contexto Histórico

- Antes de 2018: La aislamiento de tareas requería entrenar modelos distintos con funciones de pérdida diferentes $\mathcal{L}_{task}$.

- Edad Moderna: El paradigma de "Texto a Texto" permite que un solo modelo (por ejemplo, Llama-3) cambie de tarea mediante promt de cero o pocos ejemplos.

Comparación de Implementación en Python